В Соединенных Штатах разрабатывается законопроект, который может значительно изменить правила взаимодействия с искусственным интеллектом, особенно в области больших языковых моделей. Если инициативу поддержат, компании, такие как OpenAI, Anthropic и xAI, могут столкнуться с гражданской ответственностью за ошибки, допущенные их чат-ботами в 14 лицензируемых сферах — от медицины и юриспруденции до архитектуры и психологии.

По сути, это значит, что каждый совет, который дает нейросеть, например, о симптомах заболевания или юридических вопросах, может стать основанием для судебного разбирательства. Для пользователей, пострадавших от неправильных рекомендаций ИИ, открывается путь к возмещению убытков и судебных расходов, если они посчитают, что чат-бот осуществлял «незаконную практику» консультирования, разрешённую только специалистам с соответствующей лицензией.

Безопасность или угроза конкуренции?

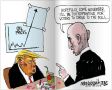

Законодатели обосновывают необходимость таких поправок защитой граждан, упоминая о печальных случаях взаимодействия пользователей с чат-ботами, включая трагические инциденты с подростками, использующими Character.AI. На их взгляд, эти меры призваны предотвратить возможные негативные последствия и обеспечить безопасность. Тем не менее, критики законопроекта поднимают вопросы о его целесообразности и даже конституционности, утверждая, что он может служить инструментом цензуры в интересах профессиональных кругов.

Потенциальные изменения для компаний

В случае принятия закона, компании окажутся перед трудным выбором: или внедрять географические блокировки, чтобы ограничить доступ пользователей к определённым видам информации, или сильно фильтровать ответы на профессиональные темы. Также рассматривается вариант внедрения премиум-подписок, которые позволят пользователям избежать этих ограничений.

Так что же в итоге теряет чат-бот по сравнению с традиционным поиском? Вопрос остается открытым, и будущее взаимодействия с ИИ может оказаться под угрозой.